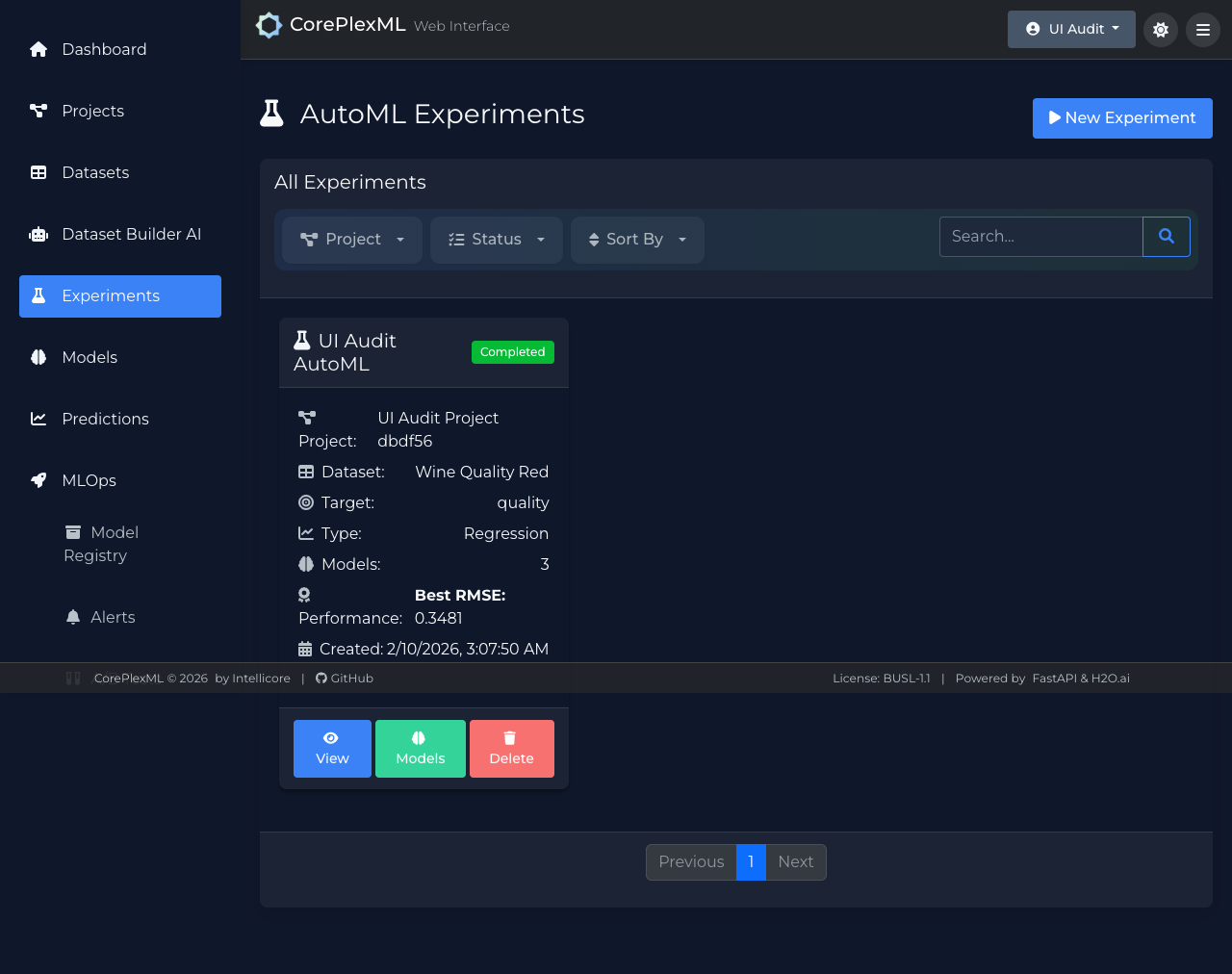

5. Experimentos, Modelos, Predicciones

Objetivo

Entrenar modelos, comparar resultados, registrar el mejor candidato y ejecutar predicciones.

Crear experimento

Abrir

Experiments.Click en

New Experiment.Configurar: - Dataset/version. - Columna target. - Tipo de problema. - Estrategia de validacion y metrica objetivo.

Iniciar corrida y monitorear estado.

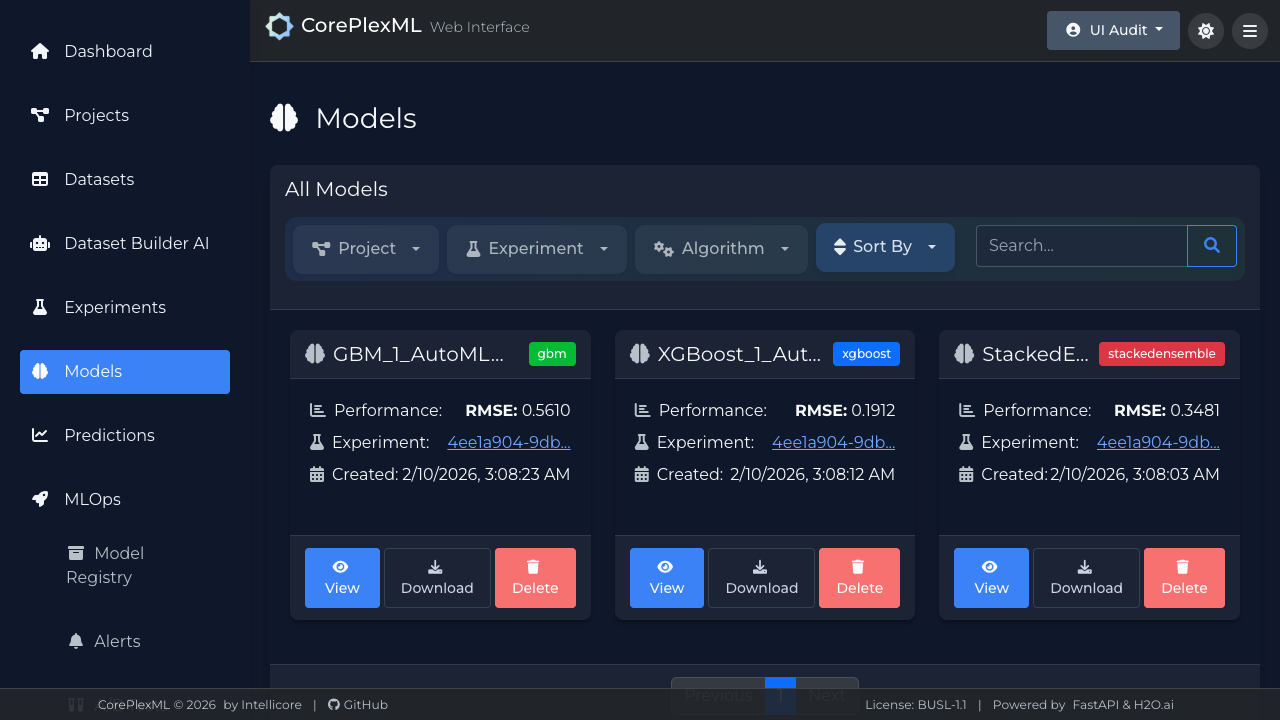

Revisar resultados y modelos

Abrir leaderboard al completar corrida.

Validar metrica primaria y ranking.

Abrir detalle del mejor modelo y revisar: - Metricas. - Explainability/importancia de features si aplica. - Metadata de artifact/version.

Registrar o fijar modelo segun flujo interno.

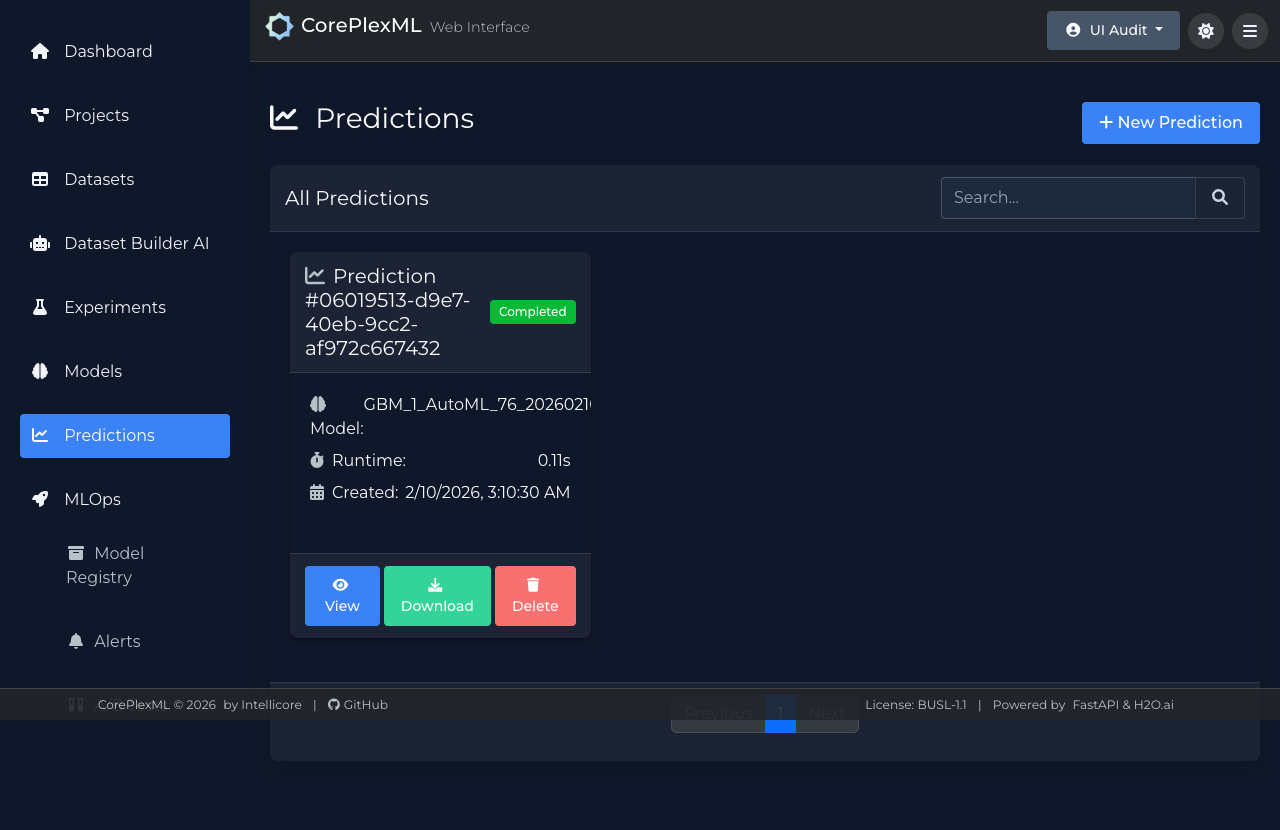

Ejecutar predicciones

Abrir

Predictions.Ejecutar prediccion individual desde formulario.

Ejecutar prediccion batch por archivo si esta disponible.

Validar campos de salida: - Valor/clase predicha. - Confianza/probabilidad si aplica. - Timestamp y referencia de corrida.

Checklist de validacion funcional

Experimento llega a estado terminal sin falla silenciosa.

Metricas de detalle coinciden con leaderboard.

Esquema de salida de prediccion es estable.

Batch conserva paridad de filas input/output.

Errores de prediccion entregan mensaje accionable.

Resultado esperado

Al menos un modelo listo para despliegue.

Predicciones consistentes y trazables.

Errores comunes y recuperacion

Falla temprana de experimento: - Revisar target y manejo de nulos.

Metrica inconsistente: - Confirmar mismo split/seed.

Input rechazado en prediccion: - Alinear nombres/tipos con schema del modelo.

Imagenes

Ejecucion de experimentos y monitoreo.

Registro de modelos con metricas y metadata.

Prediccion individual y batch desde UI.